...Но откуда он берет сведения о своей сложности? Вот тут-то термин "информация" становится необходим. Ведь этот термин, который в наше время у всех на языке и слуху, реже на уме, - характеристика не системы (скажем, живого организма или ежедневной газеты), а сигнала. Точнее, соотношения между передатчиком сигнала и его приемником:

передатчик ® канал передачи информации ® приемник

Отвлечемся, для начала, от материального воплощения сигнала - будь то радиоволны, звуковые волны, слова на бумаге, рисунки на камне или соответствующие сочетания нуклеотидов в нуклеиновых кислотах. Сначала поговорим о том, как можно измерить информационное содержание сигнала.

Основоположник теории информации К. Шеннон дал формулу, которая в настоящее время во всей человеческой деятельности играет столь же важную роль, как и эйнштейновская Е = mc^2:

Н = - k Spi log(pi)

Здесь pi - вероятность состояния системы, о котором сообщается в сигнале, log(pi) - логарифм этой вероятности и k - коэффициент пропорциональности, т.е. постоянная, определяющая единицу измерения. Н - принято называть энтропией источника сообщений, иногда просто информацией.

Эта формула очень похожа на формулу энтропии в статистической физике. Однако k там - константа Больцмана (1,37x10-16 эрг/градус). В теории информации принято двоичное исчисление и логарифмы при основании 2. Тогда k = 1 и единица измерения Н - биты (сокращенное binary digits, двоичные единицы - не путать с байтами!). Один бит - столько информации содержится в ответе на вопрос: "Кто родился: мальчик или девочка?"

В передаваемой по каналу связи информации выделяются тексты, которые можно разбить на символы, и каждому символу придать значение (энтропия на символ).

Так, если бы в тексте на русском языке все буквы, включая знаки препинания и пробел между словами (32 символа), встречались с равной частотой, информационная емкость русского алфавита равнялась бы:

-S1/32 log2l/32 = log32 = 5 бит/символ

Обычно она гораздо меньше. 5 бит/символ - это предельная величина. Но во всех реальных текстах символы встречаются с разной частотой, и энтропия обычно меньше, примерно в 2,5 раза, и приближается к двум битам на символ. Отсюда можно подсчитать и объем информации в тексте. Например, в авторском листе (единице объема рукописей) 40 000 символов и, значит, 80 000 бит информации. Но опять же это верхний предел, эта цифра имеет значение для наборщика и корректора, но не читателя. Далее мы еще вернемся к этому.

А пока ответим на вопрос: откуда развивающийся организм берет сведения о своей сложности? Ответ однозначен - из своей генетической программы, из ДНК. В ДНК "генетический текст" закодирован четырьмя символами - аденином, гуанином, цитозином и тимином. При равной частоте встречаемости символов энтропия на символ равна:

Н = - 4( 0,25 log2 0,25) = 2

То есть тексты, написанные русским языком, и текст нашей генетической программы обладают примерно равной информационной емкостью. В геноме каждого из нас содержится примерно 3,2x109 нуклеотидов; соответственно объем содержащейся в нем информации 6,4x109 бит. Любители считать могут прикинуть, библиотеке какого объема это соответствует, только пусть помнят, что в выходных данных книги указываются не авторские листы, а печатные.

Значит, им нужно сначала подсчитать число символов на страницу текста книги данного формата и умножить на число страниц. Но все эти подсчеты будут сугубо приближенные: и в случае с ДНК два бита/символ - недостижимый максимум.

Кроме того, надо учесть одно обстоятельство: чтобы превратиться в признаки и свойства организма, генетическая информация перекодируется, проходя по каналу:

ДНК --> РНК --> белок

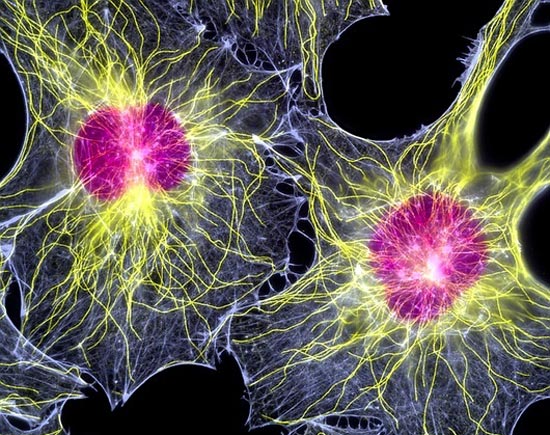

Передатчик этой информации - хромосома, приемник - цитоплазма клетки, в которой синтезируется белок. А уж от набора белковых молекул и их количества зависит дальнейшая судьба клетки и всего организма.

Первый этап перекодировки ДНК --> РНК не изменяет информационной емкости сигнала. Ведь нуклеотидный текст остается без изменения, только тимин заменяется на урацил. А это тот же тимин, только неметилированный (без группы СН3). Зато перекодировка нуклеотидного текста информационной РНК в аминокислотную последовательность белка весьма существенна.

Сейчас и в школе учат, что одна аминокислота, точнее, один аминокислотный остаток в полипептидной цепи, образующей белок, соответствует трем нуклеотидам в информационной РНК. Возможное число сочетаний из 4 по 3 - это 43, т.е. 64 символа. Если бы в наших белках было 64 аминокислоты, то энтропия на символ равнялась бы:

H = -64(1/64 log2 1/64) = 6,1 бит

Но три символа (тройки нуклеотидов, триплеты, кодоны) - бессмысленны, они аминокислот не кодируют. На них синтез полипептидной цепи обрывается, они соответствуют пробелам между словами в печатной речи и паузам - в устной. А аминокислот в белковом тексте всего 20, причем, каждая из них кодируется разным числом триплетов.

Лейцин, серии, аргинин - эти буквы белкового текста кодируются каждый шестью триплетами, а метионин и триптофан - только одним триплетом каждый. Такой код называется вырожденным.

Книга целиком

Комментарии (0)